오늘의 모범이 될 것은 Barrack Demonic입니다.

이 그림을 i2i로 직접 작업하면

이렇게 나왔습니다 (노이즈 제거 강도를 낮추어 원본과 비슷한 손가락 모양을 얻었지만 이미지의 터치감이 살아있지 않았습니다.

이와 같이 촉각을 살리기 위해 근력을 높이면 높은 확률로 자세가 바뀌거나 손이 비정상이 된다.

이런 상황에 대비해서 프롬프트를 써서 손의 타율을 높일 수 있지만 관련 프롬을 추가해도 큰 차이는 없다.

하지만 익스텐션 중 컨트롤넷을 사용한다면 손의 완성도를 더욱 높일 수 있다.

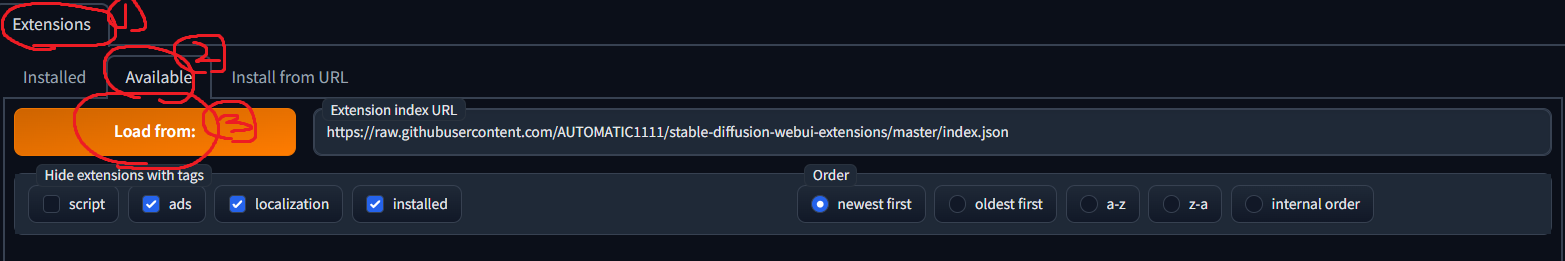

위 그림과 같이 설치할 수 있는 모든 확장을 확인하기 위해 extensions-Available-Load from을 클릭하면 controlnet을 확인할 수 있다. sd-webui-controlnet이라는 확장 프로그램을 설치하고 webui를 다시 시작합니다.

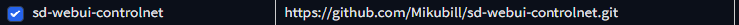

ControlNet을 설치한 후 설정으로 이동하여 ControlNet을 선택하고 사용 가능한 모델 수를 늘리십시오. 일반적으로 모델을 3~5개만 늘리면 충분합니다. 그런 다음 설정 적용을 누르고 다시 시작하십시오.

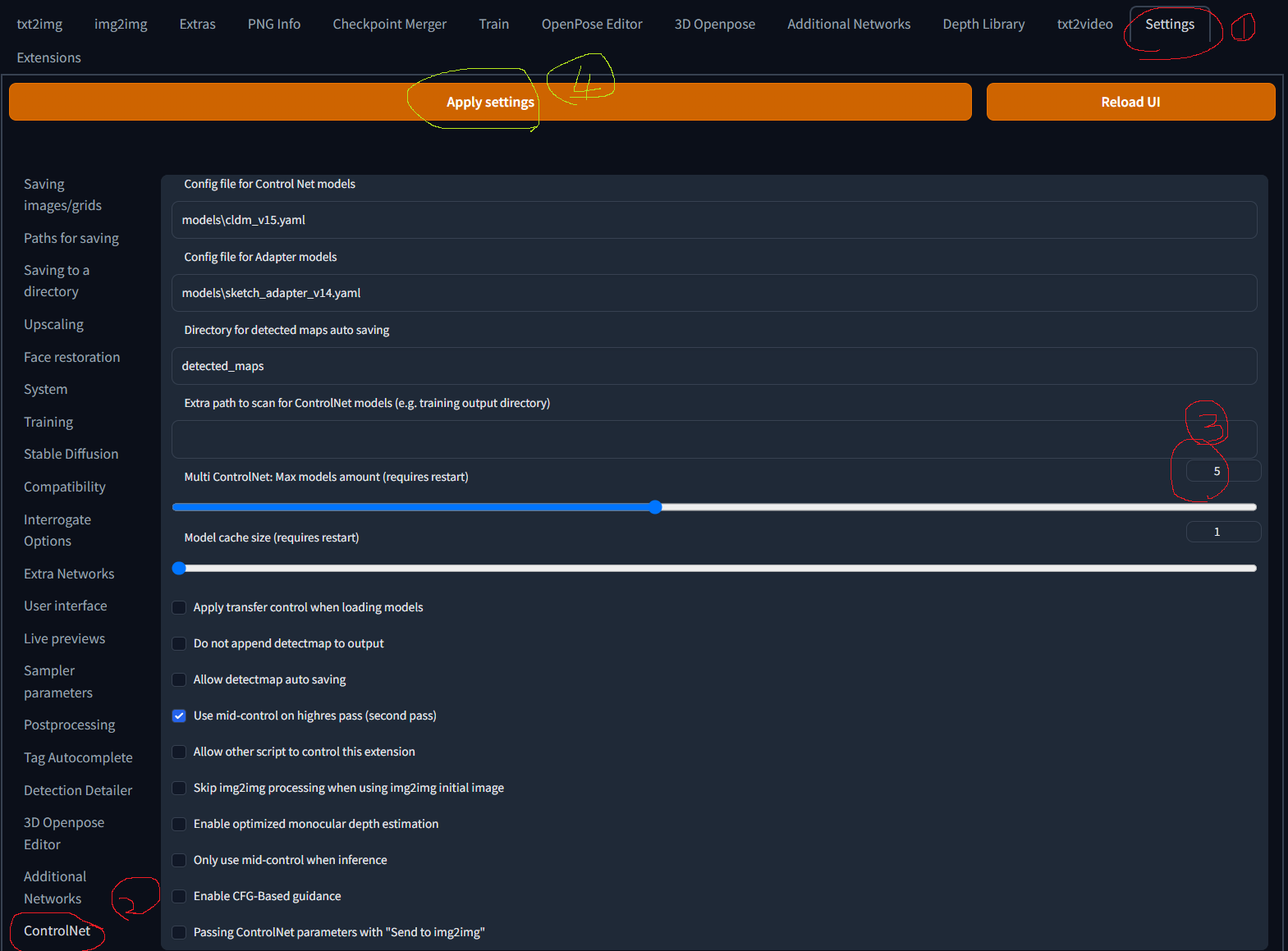

이 메뉴가 추가됩니다.

이전에 ControlNet을 설치하여 사용하셨다면 업데이트 또는 삭제 후 다시 설치하시면 편리합니다.

이제 ControlNet에서 사용할 모델을 다운로드해야 합니다.

가장 먼저 https://civitai.com/models/9251/controlnet-pre-trained-models openpose, canny, depth 등 필요한 모델을 연결하고 수용합니다. openpose는 사진을 분석하여 프레임을 만들고, canny는 선을 인식하고, depth는 그림의 차이를 통해 그림의 깊이를 인식한다고 생각하기 쉽습니다. 명도.

ControlNet 사전 훈련된 모델 | 안정적인 확산 컨트롤넷 | 치비타이

멈추다! 이 모델은 프롬프트/이미지 생성을 위한 것이 아닙니다. 이들은 ControlNet 확장에 필요한 모델이며 Safetensor로 변환되고 …

civitai.com

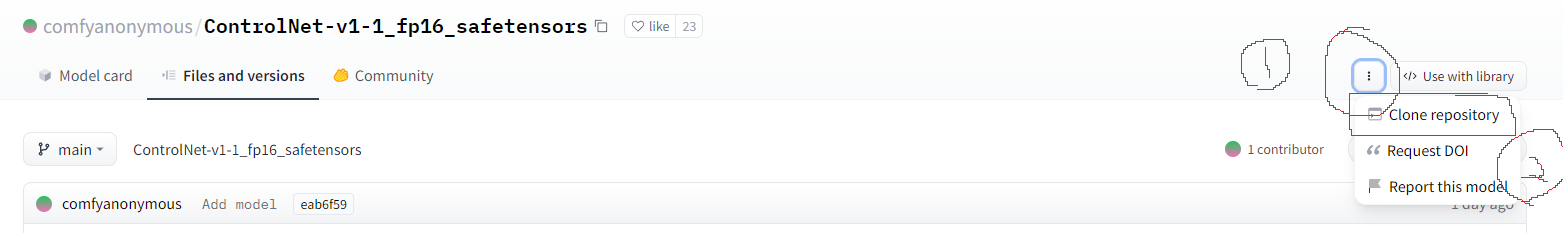

civitai가 입력되지 않으면 https://huggingface.co/lllyasviel/ControlNet/tree/main/models이 사이트에서도 다운로드할 수 있습니다. 점 3개 버튼 클릭 후 Clone Repository를 클릭하여 코드를 복사하고, 명령프롬프트 창에서 cd 명령어를 통해 extensions/controlnet/model 폴더로 경로를 설정한 후 Clone Repository에서 복사한 코드를 붙여넣으면 설치됩니다. 그 자체.

메인에서 lllyasviel/ControlNet

감지된 피클 가져오기(4) “torch.LongStorage”, “collections.OrderedDict”, “torch._utils._rebuild_tensor_v2”, “torch.FloatStorage” 피클 가져오기란?

huggingface.co

이후 https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/tree/mainhttps://huggingface.co/lllyasviel/ControlNet-v1-1/tree/main사이트로 이동하여 모든 모델을 수락합니다. (다 받을 필요는 없고, 용량이 더 작은 버전도 있지만 여유공간이 있고 귀찮으면 다 받자)

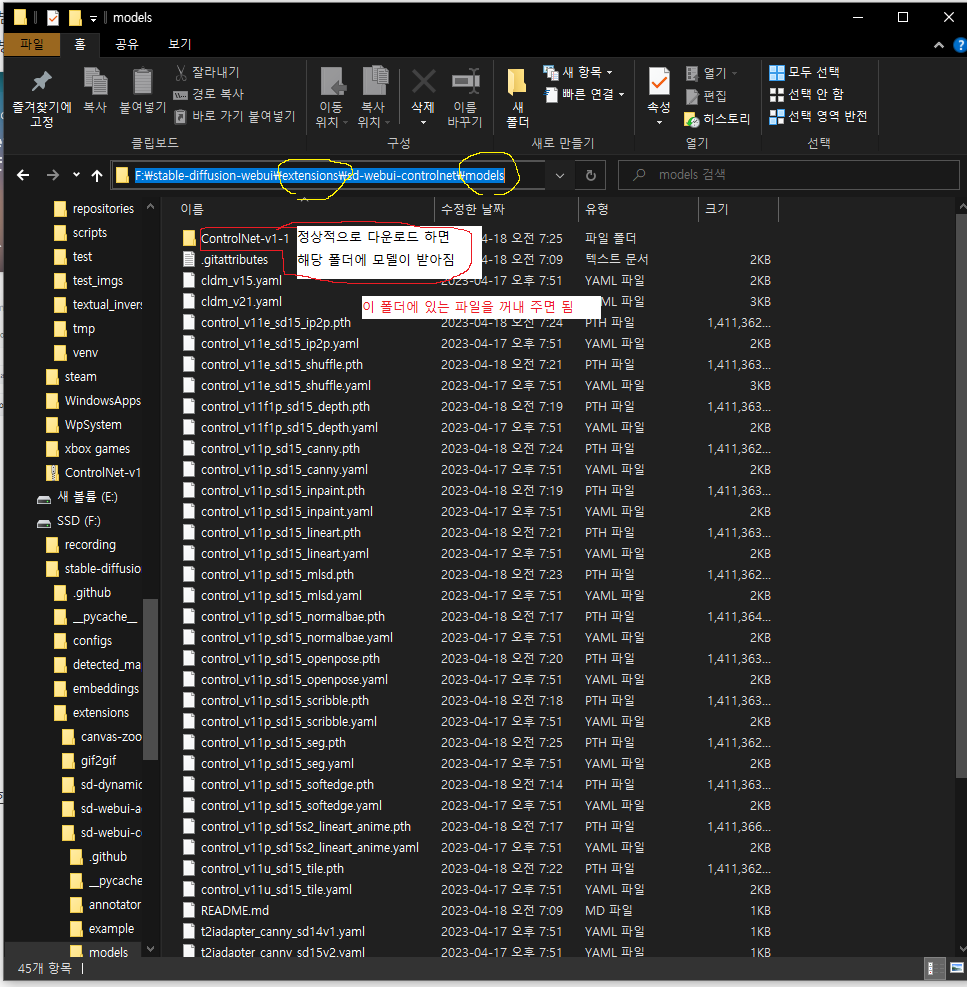

설치 방법은 동일하며 명령 프롬프트 창에서 동일한 경로에 다운로드합니다.

메인에서 comfyanonymous/ControlNet-v1-1_fp16_safetensors

huggingface.co

설치된 모델은 별도의 하위 폴더에 있으므로 잊지 말고 꺼내십시오.

이제 시도해 봅시다.

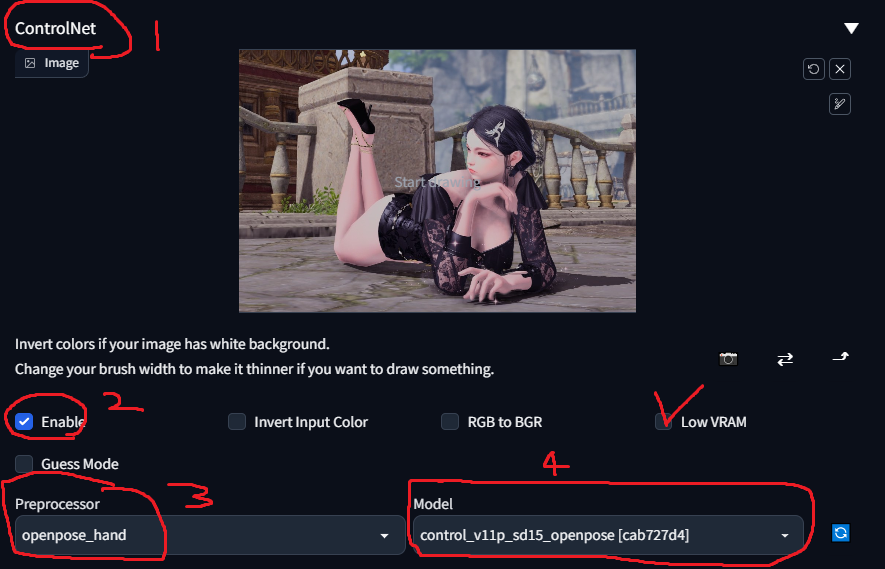

ControlNet을 클릭하면 위 그림처럼 나옵니다. 그릴 원본 이미지가 있는 것처럼 중간에 사진을 드래그 앤 드롭하고 활성화를 누릅니다. 이후 사용할 모델에 따라 전처리기와 모델을 선택하면 된다.

이미 모델에 맞는 사진(예: 오픈포즈 사진)을 가져오셨다면 전처리기를 선택하지 않으셔도 되지만 글의 도움을 받을 사람이 그런 일이 없을 것이라고 판단하므로 반드시 설정해야 한다고 생각하시면 됩니다 그것.

전처리기가 openpose이면 모델도 openpose여야 하고, canny라면 canny 모델이어야 합니다.

아래 그림에 익숙하지 않은 경우에는 만지지 않는 것이 좋습니다.

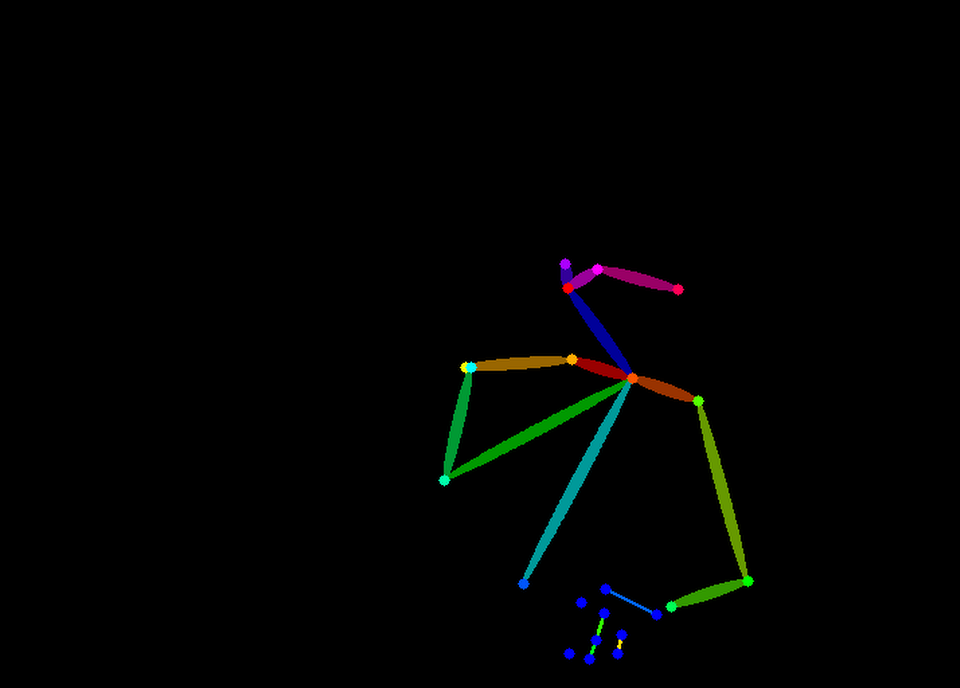

아래 그림은 전처리기의 결과이므로 이를 참고하여 필요한 방법을 찾아 사용하는 것이 좋습니다.

1. 손 펴기

이 경우 손과 피부가 겹쳐서 원본 사진의 포즈가 openpose에서 제대로 인식되지 않았던 것 같아요.

2.캐니

canny는 또한 자신이 잡고 있는 손을 제대로 인식하지 못했습니다. 하지만 아래 바닥에 있는 손을 보면 상당히 정확하게 표현되어 있음을 알 수 있다.

3. 깊이

드디어 처음으로 오른손이 나왔다. 깊이의 경우 밝기의 차이로 원근감을 표현할 수 있기 때문에 가능했다고 생각합니다.

그런데 오른손 엄지가 원본과 많이 다르게 나왔다.

4.선화

선화의 경우 손의 위치는 적절하지만 엄지 부분의 색상 차이는 피부와 거의 차이가 없어 제대로 인식되지 않는 느낌입니다.

그렇다면 캐니나 선화에서 손 인식률을 높이려면 어떻게 해야 할까?

답은 손의 윤곽을 구별하는 것입니다. 마우스로 이 작업을 수행할 수 있으며 태블릿으로 더 잘 수행할 수 있습니다.

그림과 같이 외곽선 표현이 애매한 부분은 페인트나 포토샵을 이용하여 구분 가능한 색으로 선을 그어줍니다.

그 후 canny나 lineart로 컨트롤넷을 열고 이미지를 생성하면

이미지는 이렇게 나옵니다. 물론 그 차이가 무엇인지 알고 싶고 위와 같이 엄지가 제대로 표현되지 않는 문제가 있을 수 있지만 단순히 강도를 낮추는 것보다 훨씬 다양한 결과를 얻을 수 있을 것입니다.

단, sd upscale 사용시 주의가 필요하며 controlnet에서 enable 체크를 해제 후 사용하셔야 합니다. 그렇지 않으면 컨트롤넷 이미지와 그림이 번갈아 그려지는 기괴한 그림이 됩니다.